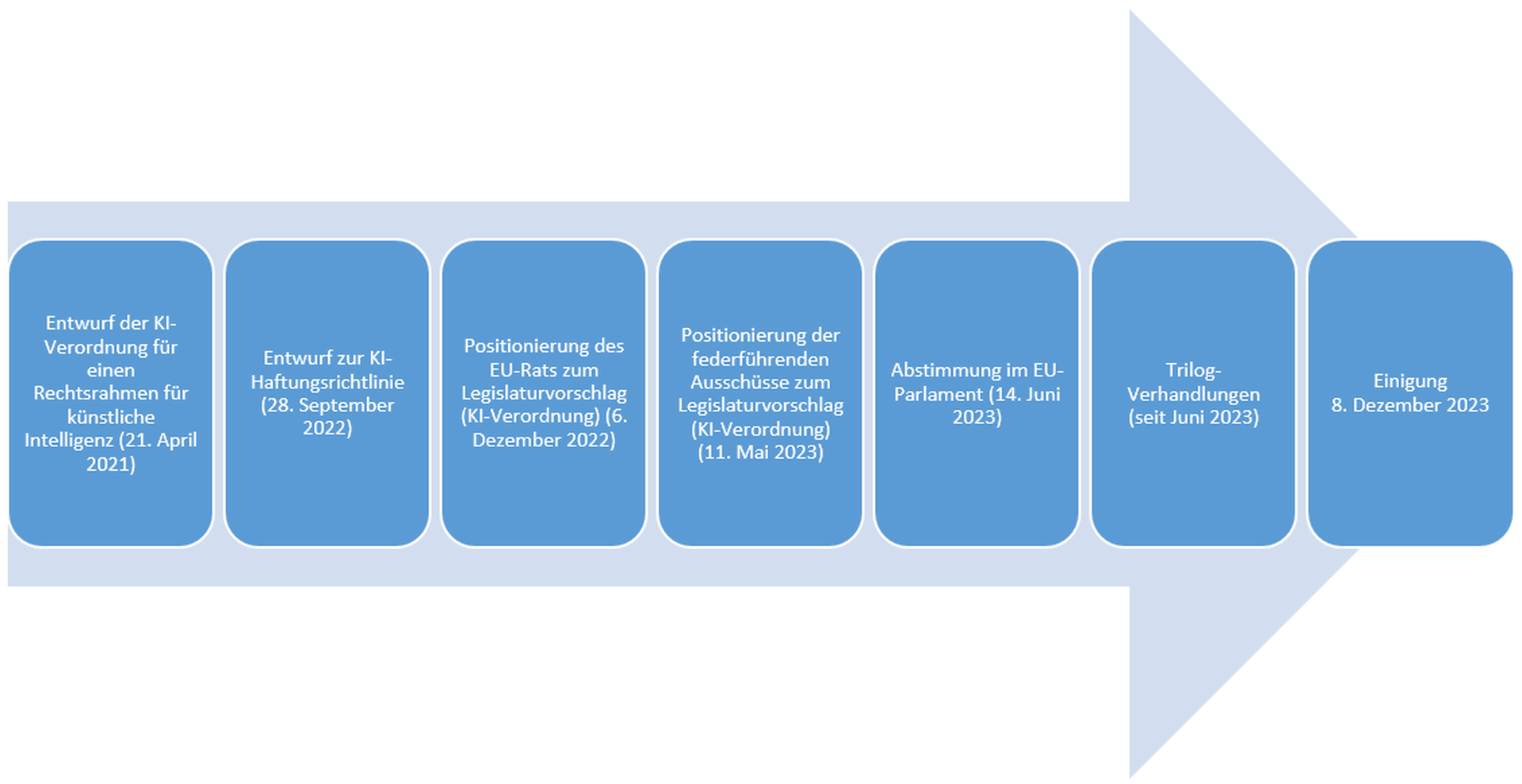

Die Europäische Union hat im Dezember 2023 nach anhaltenden Trilog-Verhandlungen eine Einigung über die KI-Verordnung erzielt. Aufgrund der zuletzt sehr unterschiedlichen Positionen und Auffassungen konnte lange nicht prognostiziert werden, wann und in welcher Form die KI-Verordnung letztlich in Kraft treten wird. Nun haben sich die EU-Kommission, Parlament und Rat am 8. Dezember 2023 auf eine gemeinsame Fassung geeinigt. Details zur finalisierten Fassung sollen in den nächsten Wochen ausgearbeitet werden. Derzeit wird eine Finalisierung der Verordnung für das Frühjahr 2024 erwartet.

1. Zeitlicher Ablauf der KI-Verordnung

Aufgrund der zunehmenden Bedeutung von KI-Anwendungen hatte die EU-Kommission bereits am 21. April 2021 den weltweit ersten Vorschlag für einen Rechtsrahmen für die Nutzung von künstlicher Intelligenz vorgelegt. Die Verordnung soll mit unmittelbarer rechtlicher Bindungswirkung im europäischen Binnenmarkt für eine engmaschige Regulierung von KI-Systemen sorgen.

Der bisherige Vorschlag der Kommission nimmt Bezug auf die „gemeinsame europäische KI-Strategie“ der Europäischen Union aus dem Jahr 2018 und die darauf basierenden „Leitlinien für Politik und Investitionen für eine vertrauenswürdige künstliche Intelligenz“ aus dem Jahr 2019. Nachdem der Rat der Europäischen Union im Dezember 2022 zur KI-Verordnung beraten und Änderungen vorgeschlagen hatte, verabschiedete im Juni 2023 auch das Europäische Parlament seine Position zum Verordnungsentwurf.

2. Ziele der KI-Verordnung gemäß Kommissionsentwurf

Die Kommission hat sich in der KI-Verordnung das Ziel gesetzt, Europa zum globalen Raum für vertrauenswürdige künstliche Intelligenz zu machen. Die EU-Kommission möchte mit der KI-Verordnung ein „ecosystem of trust“ schaffen. Die Regulierung von KI-Anwendungen soll das menschliche Vertrauen in den Einsatz von KI stärken. Gleichzeitig soll die Verordnung Rechtssicherheit schaffen, um Investitionen sowie Innovationen im Bereich der KI zu erleichtern.

3. Anwendungsbereich der KI-Verordnung gemäß Kommissionsentwurf

Die KI-Verordnung der Kommission soll über alle Wirtschafts- und Industriebereiche übergreifend für alle Akteure gelten, die entweder „Nutzer“ (derjenige, der das KI-System nicht nur für private Zwecke nutzt), „Anbieter“ (KI-Entwickler/Anbieter), „Einführer“ (Stelle, welche KI-Systeme in der Union in Verkehr bringt,) oder „Händler“ (Stelle, welche KI-Systeme auf dem Unionsmarkt bereitstellt) sind.

Der Kommissionsentwurf geht von einem zweiteiligen entwicklungsoffenen KI-Begriff aus.

Auf erster Stufe werden unter anderem die folgenden Softwareanforderungen erfasst:

- Konzepte des maschinellen Lernens, mit beaufsichtigtem, unbeaufsichtigtem und bestärkendem Lernen unter Verwendung einer breiten Palette von Methoden, einschließlich des tiefen Lernens (Deep Learning);

- Logik- und wissensgestützte Konzepte, einschließlich Wissensrepräsentation, induktiver (logischer) Programmierung, Wissensgrundlagen, Inferenz- und Deduktionsmaschinen, (symbolischer) Schlussfolgerungs- und Expertensysteme;

- Statistische Ansätze, Bayessche Schätz-, Such- und Optimierungsmethoden.

Kumulativ zur ersten Stufe muss das System auf zweiter Stufe Ergebnisse für vom Menschen zuvor festgelegte Ziele liefern können, die das Umfeld beeinflussen, mit dem das System interagiert. Als mögliche Ergebnisse werden Inhalte, Vorhersagen, Empfehlungen oder Entscheidungen genannt. Das Wort „kann“ zeigt, dass bereits die technische Fähigkeit des Systems genügt, solche Ergebnisse zu produzieren, ohne dass auch eine gezielte Verwendungsabsicht erforderlich wäre.

Der Vorschlag der Kommission wählt somit einen weiten KI-Begriff und damit einhergehenden weiten Anwendungsbereich. Er beschränkt sich insbesondere nicht auf Systeme, die unvorhersehbare Ergebnisse hervorrufen, sondern auch auf Systeme, die immer dieselben Ergebnisse hervorrufen.

4. Risikoklassifizierung der KI-Verordnung gemäß Kommissionsentwurf

Sofern der Anwendungsbereich nach Art. 3 KI-VO-E eröffnet ist, richten sich die zu erfüllenden Pflichten nach dem jeweiligen Risiko des KI-Systems. Diese Risiken sollen möglichst ausgeschlossen beziehungsweise geringgehalten werden. Die KI-Verordnung gibt dabei vor, mit welchen Schutzvorkehrungen die schädlichen Auswirkungen von KI-Systemen eingedämmt werden können und ob und auf welchem Wege Personen auf Rechtsbehelfsverfahren zurückgreifen können, falls es doch zu einer Verletzung ihrer Grundrechte durch den Betrieb von KI-basierten Systemen kommen sollte. Die KI-Verordnung unterscheidet dabei zwischen Systemen mit unannehmbaren, hohen, geringen oder minimalen Risiken.

a) Inakzeptables Risiko

Systeme, die ein „inakzeptables Risiko“ darstellen, sind verboten. Hierunter fallen zum Beispiel Systeme, die „manipulative Techniken“ anwenden oder aber biometrische Echtzeit-Fernidentifizierungssysteme.

Durch die KI-Verordnung soll etwa das sogenannte „Social-Scoring“ verboten werden. Bei „Social-Scoring“ wird eine Bewertung des sozialen Verhaltens von natürlichen oder juristischen Personen zum Zwecke der Verhaltensprognose oder -steuerung vorgenommen. Dieses Verbot galt im ersten Entwurf nur für Regierungen. Der EU-Rat und das EU-Parlament weiteten dieses Verbot allerdings auch auf Privatunternehmen aus.

Darauf basierend wird auch die sogenannte „vorausschauende Polizeiarbeit“ verboten, bei der auf Grund von Daten aus der Vergangenheit eine computergestützte Analyse durchgeführt wird, um Vorhersagen zur Wahrscheinlichkeit des Kriminalitätsgeschehens in der Zukunft treffen zu können.

Ferner wird auch der Einsatz von KI gestützter Gesichtserkennungssoftware an öffentlichen Plätzen verboten (zum Beispiel zur Strafverfolgung). Hierbei waren im Entwurf allerdings noch Schlupflöcher vorhanden, die Raum für den Einsatz von biometrischer Massenüberwachung bieten. So könnte zum Beispiel noch eine Ausnahmeklausel für die „Wahrung der nationalen Sicherheit“ eingeführt werden. Hochrisiko-Systeme die für diese Zwecke eingesetzt werden, müssten dabei allerdings Konformitätsprüfungen bestehen und über ihren Lebenszyklus hinaus bestimmte Voraussetzungen erfüllen. Das EU-Parlament sprach sich bislang allerdings für ein striktes Verbot von KI basierter Überwachung an öffentlichen Orten (sowohl in Echtzeit und auch zeitversetzt) aus.

b) Hochrisiko-KI-Systeme

Sogenannte „Hochrisiko-KI-Systeme“ dürfen nur unter bestimmten Auflagen und unter Einhaltung bestimmter Regelungen betrieben werden. Allerdings beziehen sich diese Anforderungen überwiegend auf organisatorische Anforderungen wie zum Beispiel Dokumentationspflichten und weniger um inhaltliche Vorgaben.

Zu den Hochrisiko-KI-Systemen gehören etwa KI-Systeme, die als Sicherheitskomponenten in Medizinprodukten nach der Medizinprodukteverordnung implementiert werden oder KI-Systeme, die selbst ein Medizinprodukt im Sinne der Medizinprodukteverordnung darstellen.

c) KI-Systeme mit geringem oder minimalem Risiko

Als „risikoarm“ eingestufte Systeme können ohne weitere, besondere Auflagen betrieben werden. Anbieter solcher Systeme werden durch die KI-Verordnung dazu ermutigt, sich selbst einen Verhaltenskodex (Code of Conduct) zu geben. Die EU-Kommission und die Mitgliedstaaten sollen die Aufstellung solcher Kodizes fördern und erleichtern.

Daneben sind Pflichten für bestimmte KI-Systeme vorgesehen, ohne dass es sich hierbei um ein Hochrisiko-KI-System handeln muss. Dabei wird auch auf die derzeit medial in aller Munde befindlichen KI-Anwendungen rund um sog. Deepfakes eingegangen. Hierbei handelt es sich um Bild-, Ton- oder Videoinhalte, die von einer KI erzeugt oder manipuliert werden und hierdurch realen Personen, Gegenständen, Orten oder anderen Einrichtungen oder Ereignissen merklich ähneln und einer Person fälschlicherweise als echt oder wahrhaftig erscheinen. In solchen Situationen muss das KI-System offenlegen, dass die Inhalte künstlich erzeugt oder manipuliert wurden. Denkbar wäre etwa die Einbindung eines Wasserzeichens.

Bei Texten, Daten oder sonstigen Informationen, die von einer generativen KI erzeugt werden und ebenfalls Fälschungen enthalten können, gilt diese Kennzeichnungspflicht im bisherigen Entwurf dagegen nicht.

5. Pflichten der Anbieter bei Hochrisiko-KI-Systemen

Anbieter von Hochrisiko-KI-Systemen sind verpflichtet, eine Reihe von Pflichten zu erfüllen:

Hierzu gehört die Einrichtung eines dokumentierten und regelmäßig aktualisierten Risikomanagementsystems sowie die Durchführung von Vorabtests. Weiterhin müssen Daten, mit denen Hochrisiko-KI-Systeme trainiert werden, bestimmten Qualitätskriterien entsprechen und bereits im Entwicklungsprozess auf mögliche Vorurteile etc. („possible biases“) untersucht werden, um keine bestehenden Diskriminierungen weiter zu verbreiten. Weiterhin müssen die Daten repräsentativ und „fehlerfrei“ sein, wobei eine genaue Definition der Begriffe bislang noch aussteht.

Hochrisiko-KI-Systeme müssen dergestalt entwickelt werden, dass eine Dokumentation und Protokollierung während des Betriebs möglich ist (sogenannte „logs“), um die Ergebnisse des Systems zurückverfolgen zu können. Hier liegt gleichzeitig das „Problem“ für die Anbieter, die Protokollierung dergestalt vorzunehmen, dass diese gleichzeitig auch den Anforderungen der DSGVO genügt, soweit die Eingaben zugleich personenbezogene Daten darstellen können.

Die Konzepte und die Entwicklung der KI-Systeme müssen für den Nutzer hinreichend transparent sein, damit Nutzer die Ergebnisse des Systems angemessen interpretieren und verwenden können. Der Anbieter muss dem Nutzer eine Gebrauchsanweisung an die Hand geben, die den Nutzer über die Zweckbestimmung und die ordnungsgemäße Verwendung des KI-Systems informieren. Dies soll zugleich die Nutzer befähigen, ihre Pflichten nach der KI-VO einzuhalten.

Der Anbieter muss zudem dafür sorgen, dass das Hochrisiko-KI-System während seines gesamten Lebenszyklus ein angemessenes Maß an Genauigkeit, Robustheit und Cybersicherheit erreicht.

Als zentrale Kontrollregelung im Rahmen der Anbieterpflichten ist vorgesehen, dass Hochrisiko-KI-Systeme während des laufenden Betriebs von menschlichen Anwendern überwacht und notfalls gestoppt werden können.

Ein Hochrisiko-KI-System darf schließlich nur nach dem Bestehen einer Konformitätsprüfung in der EU in Betrieb genommen werden.

Weiterhin ist eine „EU-Datenbank“ geplant, in der die sogenannten Hochrisiko-Systeme registriert werden sollen. Allerdings ist dies vorerst nur für in der EU erhältliche und geführte Systeme geplant und es ist auch keine Verpflichtung vorgesehen, dass Informationen zum Anwendungskontext bereitgestellt werden müssten.

6. Pflichten der Nutzer bei Hochrisiko-KI-Systemen

Auch gewerbliche Nutzer von Hochrisiko-KI-Systemen treffen nach dem Kommissionsentwurf eine Reihe von Pflichten:

So sind Nutzer verpflichtet, Hochrisiko-KI-Systeme nach Maßgabe der Gebrauchsanweisung zu nutzen und zu überwachen. Außerdem müssen Eingabedaten der Zweckbestimmung des Hochrisiko-KI-Systems entsprechen, soweit sie der Kontrolle der Nutzer unterliegen. Die im Rahmen des Hochrisiko-KI-Systems automatisch erzeugten Protokolle müssen aufbewahrt werden.

Schließlich ist eine interessante Verknüpfung zum Datenschutzrecht vorgesehen, die im Einzelfall sogar zu Erleichterungen führen kann: Sofern es im Zusammenhang mit dem Einsatz von Hochrisiko-KI-Systemen zur Verarbeitung personenbezogener Daten kommt und die Durchführung einer Datenschutz-Folgenabschätzung erforderlich werden kann, sind die bereitgestellten Informationen zur Durchführung der Datenschutz-Folgenabschätzung zu verwenden.

7. Rechtsfolgen bei Verstößen gegen die KI-Verordnung

Bislang sind bei Verstößen gegen die KI-Verordnung (erhebliche) Bußgelder geplant. So können bei Verstößen bezüglich KI-Systemen mit inakzeptablem Risiko oder der Datenqualität Bußgelder von bis zu 6 % des weltweiten Umsatzes oder bis zu EUR 30 Millionen verhängt werden. Bei Nichteinhaltung der übrigen Anforderungen an KI-Systeme können bis zu 4 % des weltweiten Jahresumsatzes oder bis zu EUR 20 Millionen und bei Übermittlung falscher, unvollständiger oder irreführender Informationen an die zuständigen Stellen bis zu 2 % des weltweiten Jahresumsatzes oder bis zu EUR 10 Millionen fällig werden.

Auffällig ist, dass bislang keine Ausnahmeregelung für die Bußgeldverhängung gegenüber Behörden und öffentlichen Stellen vorgesehen ist, wie sie etwa aus der DSGVO bekannt ist.

8. Nächste Schritte und Handlungsempfehlungen

Die am 8. Dezember 2023 erzielte Einigung soll in den nächsten Wochen konkretisiert und formal ausgefertigt werden.

Wie es schon im Rahmen der Datenschutz-Grundverordnung vorgesehen war, sieht der Entwurf der KI-Verordnung eine Übergangsfrist von 24 Monaten vor, bis er nach Inkrafttreten anwendbar und dann in den EU-Mitgliedsstaaten unmittelbar gelten wird.

Obgleich die unmittelbare Anwendbarkeit der KI-VO daher noch ein wenig auf sich warten lassen wird, sollten Unternehmen und Einrichtungen schon jetzt bei der systematischen Planung und Nutzung die zu erwartenden Implikationen der KI-VO mit im Blick haben.

Auch sollte bedacht werden, dass bereits gegenwärtig eine Vielzahl an rechtlichen Rahmenbedingungen beim Einsatz von KI im Unternehmenskontext zu berücksichtigen sind. Diese gegenwärtigen rechtlichen Fragestellungen reichen vom Datenschutz- und Geheimnisschutzrecht über das Urheberrecht bis hin zu allgemeinen Fragen nach Haftung und Verantwortung beim Einsatz von KI.

Aus diesen Gründen und auch bestärkt durch die kommende KI-VO sollte einer geplanten Einführung von KI-Systemen in Unternehmen und Einrichtungen eine unternehmensweite KI-Strategie vorausgehen, in der Leitlinien und Grundsätze vor dem Hintergrund des geltenden und zukünftigen Rechts formuliert werden und etwa Bereiche und Anwendungsgebiete definiert werden, für welche KI im Unternehmen oder in Einrichtungen verwendet werden sollen oder nicht eingesetzt werden dürfen. Außerdem sollten unternehmensinterne Leitlinien zum Umgang mit KI erstellt und die eigenen Beschäftigten über die Möglichkeiten im Umgang mit KI-Systemen informiert, im Umgang mit KI geschult und über mögliche Risiken bei der Anwendung aufgeklärt werden.

Für weitere Fragen zum Thema Künstliche Intelligenz oder zum IT & Datenschutzrecht im allgemeinen steht Ihnen unsere Praxisgruppe IT & Datenschutzrecht bei RITTERSHAUS gerne zur Verfügung.